案例

圖解

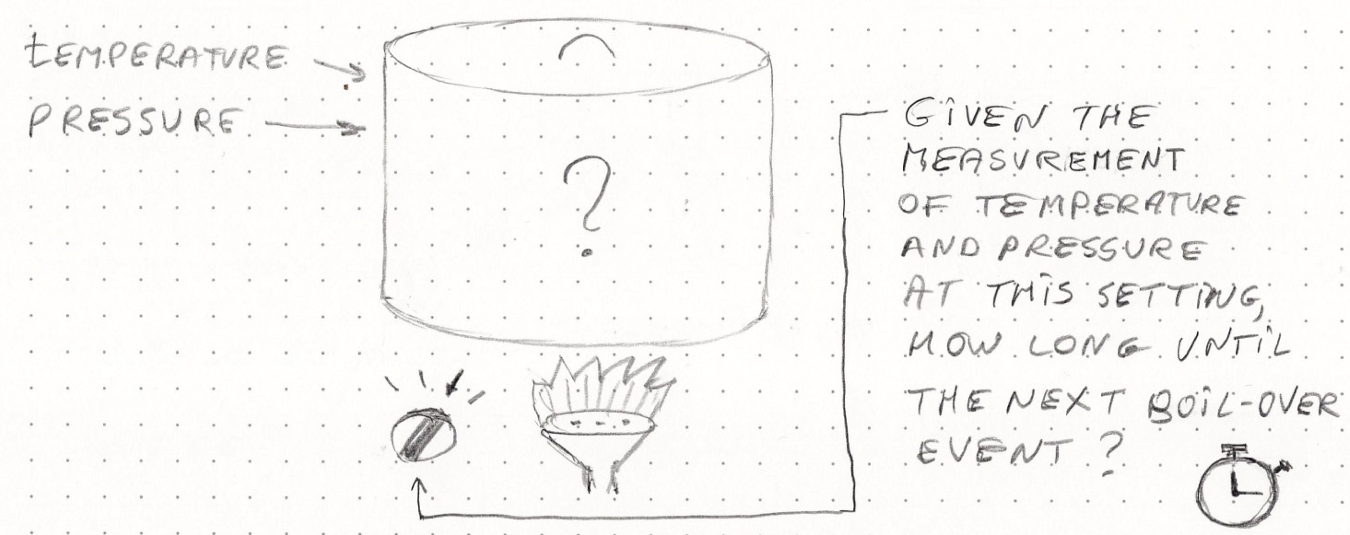

理想化的版本:把流程抽象成可建模的因果關係,彷彿輸入一組參數就能得到穩定的最佳輸出。

Source in book: Chapter 1

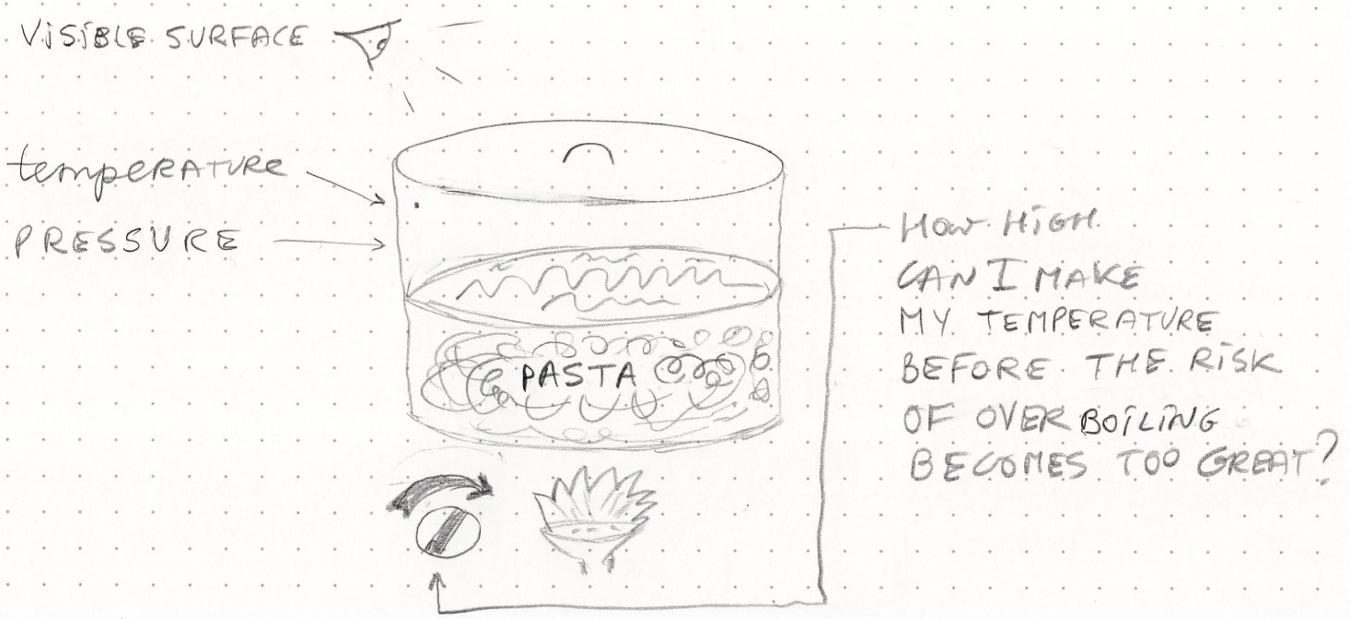

現實的版本:每個現場的設備、環境、操作習慣、資料品質不同,系統行為也跟著漂移。

Source in book: Chapter 1

例子(案例裡常見的失真)

- 問題句子會滑動:今天在預測 A,明天變成預測 B,最後變成「順便把整套流程自動化」。

- 資料名詞表看起來一致:欄位名稱相同,採樣方式不同,語意也跟著不同。

- 現場差異被當成小噪音:結果在部署階段一次爆出來,變成每個現場都要重做。

- 介面缺少保護欄:系統一旦不可靠,使用者只能放棄或繞路,產品失去存在感。

方法(把教訓收斂成可檢核的問題)

方法(把討論落在同一張表)

下面這張表就是「風險雷達」的最小版。你寫完,會知道下一步要補的是更清楚的定義與邊界,也會知道哪些模型實驗值得做。

| 面向 | 你要寫下的內容 | 用來問誰 |

|---|---|---|

| 問題句子 | 一句話定義:誰在什麼情境下,要完成什麼任務 | PM / Domain expert |

| 輸入資料 | 來源、採樣方式、缺值與校正方式 | Data / Eng |

| 場域差異 | 3 個會讓結果變形的差異來源 | Domain expert |

| 失敗樣態 | 3 種最可能的錯,使用者會看到什麼症狀 | UX / Support |

| 保護欄 | 替代流程、提示方式、回退機制 | UX / Eng |

練習

- 選一個你正在做的 AI 題目。

- 用上面的表填完五列,每列先寫一句話就好。

- 回去看案例:你的表裡有沒有出現「每個現場一套」的跡象?

想看一個很短的示範

問題句子:客服主管要在高峰時段把重複問題交給自動回覆,並把高風險案件快速分流給真人。

保護欄:信心不足時自動轉真人,並把原因與對話脈絡完整交接。